Как интегрировать ИИ в мобильное приложение без переработки архитектуры

Бизнес всё чаще сталкивается с необходимостью добавить интеллектуальные функции в цифровые продукты. Персонализация контента, умный поиск, автоматизация поддержки, прогнозирование поведения пользователей — эти возможности повышают ценность приложения и укрепляют лояльность аудитории. Однако полная переработка архитектуры ради одной AI-фичи редко оправдана с точки зрения бюджета, сроков и операционных рисков.

В большинстве случаев искусственный интеллект можно интегрировать поэтапно, без остановки текущей разработки и без угрозы для стабильности продукта. В этом материале мы разберём проверенные архитектурные подходы, практические лайфхаки и юридические нюансы, которые помогут внедрить ИИ в мобильное приложение с минимальными изменениями в коде и максимальным эффектом для бизнеса.

Определяем задачу

Частая ошибка команд — начинать интеграцию с выбора модели или провайдера. Сначала ответьте на вопрос: какую бизнес-метрику должна улучшить новая функция. Рост конверсии на этапе оформления заказа? Снижение нагрузки на первую линию поддержки? Увеличение среднего времени сессии? Когда цель сформулирована конкретно, проще подобрать техническое решение и оценить его эффективность после внедрения.

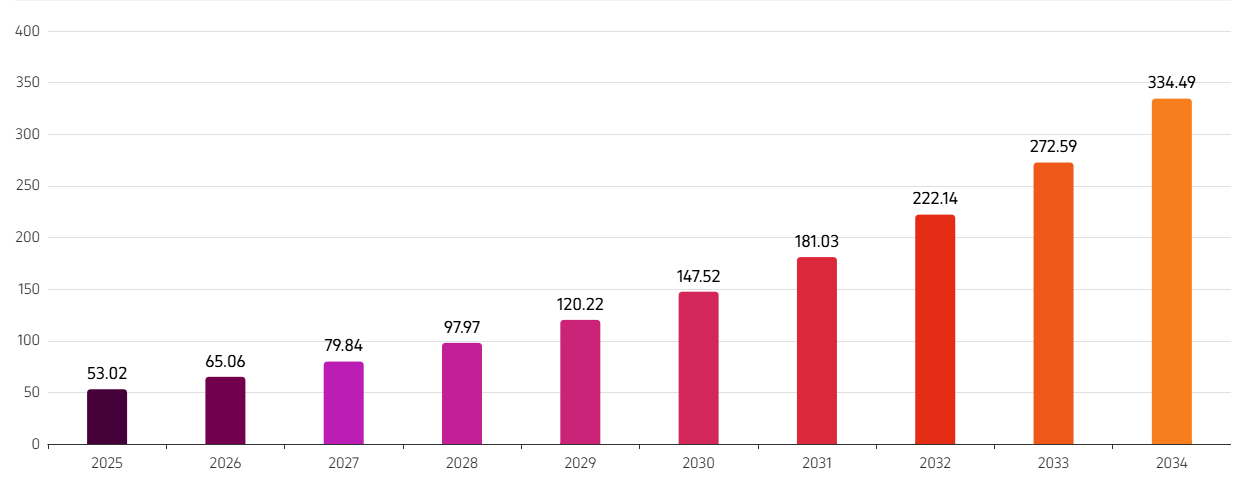

По данным исследований, к 2026 году около 40% корпоративных приложений будут включать специализированных ИИ-агентов. Это означает, что интеграция перестала быть экспериментом и стала стандартной практикой. Но успех зависит не от сложности модели, а от того, насколько точно она встроена в пользовательский сценарий.

Начните с аудита существующего приложения. Выявите точки, где пользователи сталкиваются с трудностями: долгий поиск товаров, сложная навигация, повторяющиеся вопросы в поддержке. Эти боли идеальные кандидаты для автоматизации с помощью ИИ. Приоритизируйте сценарии по двум критериям: потенциальное влияние на бизнес-метрики и техническая сложность реализации. Выбирайте задачи с высокой отдачей и низкой сложностью для первого пилота.

Архитектура внедрения

Интеграция через API

Наиболее распространённый подход рассматривает ИИ как внешний сервис. Ваше приложение отправляет структурированный запрос на конечную точку, получает прогноз или рекомендацию и включает результат в свою логику. Именно так большинство платформ подключаются к сервисам вроде Yandex Cloud AI, SberCloud AI или внутренне развёрнутым моделям через REST-интерфейс.

Интеграция по API хорошо работает в следующих случаях:

- Обработка данных требует больших вычислительных ресурсов и выигрывает от специализированной инфраструктуры

- Вам нужна возможность менять провайдера ИИ без переписывания кода приложения

- Множеству модулей приложения необходим доступ к одним и тем же возможностям искусственного интеллекта

- Команда хочет быстро запустить управляемый сервис перед инвестициями в кастомные модели

Основной минус этого подхода - задержки при обработке данных. Для функций, работающих в реальном времени, где пользователи ожидают мгновенных ответов, это имеет значение. Решайте проблему через кэширование частых запросов, пакетную обработку и асинхронные алгоритмы.

Архитектурное преимущество - чёткое разделение ответственности. Ваше приложение зависит не от деталей реализации, а от входных и выходных контрактов. Замена моделей, тестирование провайдеров или обновление возможностей будет изолированным изменением, не затрагивающим всю систему.

Для российских реалиях важно учитывать доступность зарубежных сервисов. Если ваше приложение ориентировано на пользователей из РФ, предпочтительнее использовать отечественные платформы: Yandex Cloud с моделями YandexGPT, SberCloud с GigaChat и Kandinsky, VK Cloud с решениями на базе ruGPT. Это обеспечивает соответствие требованиям 152-ФЗ о локализации персональных данных и снижает риски санкционных ограничений.

Локальные модели

Некоторые модели достаточно легковесны, чтобы работать непосредственно в процессе вашего приложения. Вместо сетевых запросов код загружает модель в память и выполняет прогнозирование локально. Это полностью исключает сетевую задержку.

Фреймворки вроде TensorFlow Lite, PyTorch Mobile и Core ML позволяют запускать оптимизированные нейросети прямо на устройстве пользователя. Это снижает зависимость от соединения, уменьшает задержки и исключает передачу чувствительной информации во внешние системы.

Использовать локальные модели нужно в следующих случаях:

- Требования к времени отклика измеряются в миллисекундах

- Приложение должно работать в офлайн-режиме или при нестабильном соединении

- Требования к защите персональных данных запрещают передачу информации внешним сервисам

- Задача вывода достаточно специфична и чётко определена для компактной модели

Минусы подхода в потреблении ресурсов устройства. Модели используют память и процессор, которые были бы потрачены на обработку пользовательских запросов.

Для большинства мобильных проектов локальные модели лучше всего подходят для конкретных функций, критичных по задержке: распознавание лиц для входа в приложение, офлайн-перевод интерфейса, предсказание следующего слова в клавиатуре.

Яркий пример — приложение для оценки качества краба. Краболовы работают в удалённых бухтах и открытом море, где интернет не ловит. Локальная модель анализирует изображение улова прямо на смартфоне и выдаёт оценку без подключения к сети. В таких сценариях облачные сервисы просто неприменимы, а встроенный ИИ становится единственным рабочим решением.

Гибридная архитектура

Комбинация подходов, особенно в условиях ограничения интернета в РФ, будет полезна для многих проектов. Критичные по скорости или конфиденциальности функции выполняются локально, а ресурсоёмкие задачи в облаке. Например, предварительная обработка изображения (обрезка, нормализация, сжатие) происходит на устройстве, а сложный анализ на сервере.

Гибридный подход даёт гибкость: вы можете масштабировать облачную часть под нагрузку, не затрагивая клиентское приложение, и постепенно переносить функции между слоями по мере изменения требований. Это особенно актуально для разработчиков, которые вынуждены балансировать между производительностью, стоимостью и регуляторными ограничениями.

Пример архитектуры: мобильное приложение использует локальную модель для базовой модерации пользовательского контента, фильтрации очевидного спама и нецензурной лексики. При этом сложные кейсы, распознавание контекста, выявление манипуляций, анализ тональности, отправляются на сервер, где работает более мощная модель. Результаты серверной обработки кэшируются на устройстве для ускорения повторных запросов.

Работа с данными

Модели ИИ нуждаются в данных в большом объёме, причём в форматах, которые ваша существующая база данных не рассчитана поддерживать. Решение вопроса доступа к данным это важное решение на любом проекте.

Оптимизация доступа

Ваша производственная база данных оптимизирована для транзакционных нагрузок: быстрая запись, согласованное чтение, высокая параллельность. Искусственному интеллекту нужны: массовое чтение, сложные агрегации, исторические данные, объединение больших наборов.

Выполнение запросов ИИ непосредственно к производственной базе создаёт конкуренцию за ресурсы. Аналитические запросы конкурируют с пользовательскими транзакциями. Задача обучения модели может перегрузить дисковый ввод-вывод, замедляя работу всего приложения. Решение заключается не в том, чтобы заставлять одну базу обслуживать обе нагрузки. Оно заключается в создании путей передачи данных, адаптированных к потребностям ИИ.

Производственная база данных оптимизирована для транзакционных операций с высокой параллельностью. Алгоритмам машинного обучения требуется массовое чтение и сложные агрегации исторических записей. Прямые аналитические запросы создают конкуренцию за ресурсы с пользовательскими транзакциями.

Реплики для чтения становятся простым решением изоляции аналитической нагрузки. Это постоянно синхронизируемые копии основной базы данных. Направление трафика ИИ на реплики защищает продакшен от замедления при сложных выборках. Задержка репликации составляет несколько секунд и приемлема для рекомендаций, персонализации и оценки мошенничества.

Хранилища данных поддерживают сложные агрегации из разных источников информации. Системы вроде Yandex DataLens, SberCloud Data Platform или ClickHouse оптимизированы для аналитических запросов в больших масштабах. Конвейеры ETL синхронизируют необходимые данные по расписанию, соответствующему требованиям бизнеса. Операционная база продолжает фокусироваться на транзакциях при наличии выделенной аналитической инфраструктуры.

Векторные базы данных обеспечивают быстрый поиск семантически близких записей для рекомендательных систем. Инженеры настраивают автоматическую очистку устаревших логов для экономии дискового пространства. Метрики качества конвейеров отслеживаются в реальном времени для оперативного реагирования на сбои.

Требования к персональным данным

Приложения с персональными данными граждан РФ соблюдают положения Федерального закона № 152-ФЗ. Хранение и обработка информации осуществляются на территории Российской Федерации для соответствия регуляторным нормам. Передача данных третьим лицам требует получения явного согласия пользователя на обработку. Техническая защита предотвращает несанкционированный доступ к конфиденциальным массивам информации.

Интеграция зарубежных ИИ-сервисов требует проверки возможности локализации данных в российских дата-центрах. Отечественные платформы вроде Yandex Cloud и SberCloud обеспечивают соблюдение требований через готовую инфраструктуру. Невыполнение положений закона влечёт штрафы до шести миллионов рублей для юридических лиц. Регуляторы могут заблокировать приложение на территории страны при систематических нарушениях.

Анонимизация записей позволяет использовать данные для обучения моделей без раскрытия личностей пользователей. Шифрование каналов связи защищает трафик от перехвата при передаче между компонентами системы. Журналы аудита фиксируют все обращения к персональной информации для отчётности перед контролирующими органами. Регулярные проверки безопасности выявляют уязвимости в архитектуре до возникновения инцидентов.

Выбор между готовыми API и кастомными моделями

Не каждая функция ИИ требует обучения моделей с нуля. Понимание того, когда лучше использовать готовое решение, а когда разрабатывать собственное, определяет скорость внедрения и объём текущего обслуживания.

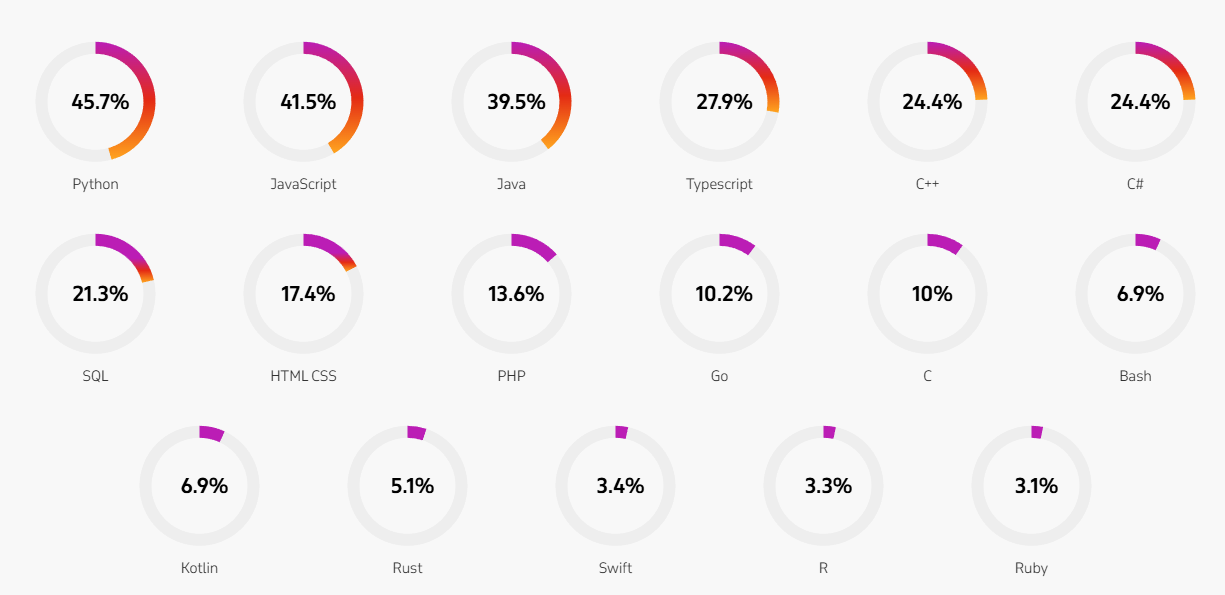

Когда выбирать готовые API

Управляемые сервисы искусственного интеллекта надёжно решают стандартные задачи без специализированного обучения. Обработка естественного языка, анализ тональности, извлечение сущностей, классификация изображений, транскрипция речи и модерация контента работают стабильно в разных отраслях. Эти возможности прошли масштабное тестирование и регулярно обновляются провайдерами.

Предварительно обученные модели покрывают большую часть первоначальных сценариев для команд, которые только начинают внедрение ИИ. Работа по интеграции фокусируется на проектировании интерфейсов, обработке ошибок и оптимизации производительности. Команда не тратит ресурсы на разработку алгоритмов машинного обучения с нуля.

Функции, на создание которых с использованием кастомных моделей ушли бы месяцы, реализуются за несколько недель при подключении управляемых сервисов. Это позволяет быстро запустить пилот, собрать обратную связь от пользователей и обосновать дальнейшие инвестиции. Готовые API становятся точкой входа для проверки гипотез перед переходом к более сложным решениям.

Условия для кастомных моделей

Собственные алгоритмы разрабатывают при глубокой специализации в предметной области. Медицинская диагностика, анализ юридических документов и контроль производственных дефектов требуют уникального контекста. Универсальные нейросети не распознают узкопрофильную терминологию и отраслевые стандарты. Когда интеллектуальные функции становятся ключевым преимуществом продукта, качество алгоритмов напрямую влияет на рыночную позицию. Инвестиции в индивидуальную разработку создают долгосрочные конкурентные преимущества, которые недоступны стандартным облачным сервисам.

Регулируемые отрасли требуют полной объяснимости автоматических решений для прохождения внешних аудитов. Пользовательские модели позволяют детально анализировать обучающие выборки и проверять алгоритмы на скрытую предвзятость. Требования закона 152-ФЗ и отраслевые стандарты часто запрещают передавать информацию внешним провайдерам. Развёртывание нейросетей во внутренней инфраструктуре гарантирует хранение конфиденциальных данных в защищённом контуре. Команда сохраняет полный контроль над жизненным циклом модели и соответствует требованиям регуляторов.

Путь начинается с подключения управляемых сервисов для проверки гипотез. Доказанная эффективность сценария использования обосновывает переход к индивидуальной разработке. Универсальные решения оцениваются на предмет соответствия конкретным бизнес-задачам и объёмам трафика. Кастомизация становится следующим шагом при выявлении ограничений стандартных платформ. Такой подход минимизирует первоначальные риски и сохраняет возможность масштабирования алгоритмов по мере роста продукта.

Распространённые ошибки и как их избежать

Проверка качества данных

Алгоритмы машинного обучения автоматически усиливают закономерности, заложенные в обучающей выборке. Низкое качество исходных данных приводит к систематическим ошибкам в прогнозах модели. Предвзятые примеры формируют дискриминационные паттерны в принятии автоматических решений.

Команда проводит аудит информации перед стартом работ по интеграции. Специалисты оценивают точность записей, полноту полей и репрезентативность выборки для всех сегментов пользователей. Очистка от дубликатов и аномалий повышает надёжность итоговых результатов.

Модель подбора персонала, обученная на исторически смещённых данных, воспроизводит дискриминационные практики при отборе кандидатов. Рекомендательная система, построенная на искажённых поведенческих логах, предлагает нерелевантный контент и снижает вовлечённость аудитории. Валидация датасета на этапе подготовки экономит ресурсы на исправление ошибок после запуска.

Нагрузочное тестирование

Вычислительная сложность алгоритмов искусственного интеллекта редко проявляется на этапе локальной разработки. Модель может мгновенно отвечать на единичные запросы в тестовой среде, но сталкиваться с серьёзными задержками при реальной нагрузке. Проведение нагрузочного тестирования перед релизом становится обязательным этапом интеграции.

Инженеры моделируют трафик, максимально приближенный к поведению живой аудитории. Специалисты замеряют время отклика при параллельных обращениях и отслеживают потребление оперативной памяти. Анализ загрузки центрального процессора помогает выявить скрытые узкие места архитектуры. Проверка горизонтального масштабирования показывает, как система поведёт себя при внезапном росте числа пользователей.

Обнаружение проблем на тестовых стендах требует времени, но защищает бизнес от дорогостоящих простоев. Исправление ошибок в работающем продакшене обходится компании значительно дороже. Регулярные стресс-тесты обеспечивают стабильность сервиса и сохраняют доверие конечных пользователей.

Объяснимость моделей

Команда должна понимать принципы принятия решений даже при использовании сторонних моделей. Влияние входных параметров на результаты документируется для последующей диагностики инцидентов. Прогнозы могут ухудшаться в процессе эксплуатации без явной первопричины для быстрого анализа.

Инструменты объяснимости помогают выявлять проблемы внутри компании без ожидания поддержки провайдера. Тестирование граничных случаев своевременно обнаруживает слабые места в работе алгоритмов. Специалисты фиксируют контекст запросов и ответов для воспроизведения сценариев при разборе ошибок.

Логи входных данных и прогнозов модели сохраняются в структурированном виде. Журналы позволяют отследить, при каких условиях система начинает выдавать неточные результаты. Документирование известных ограничений и сценариев отказа ускоряет реакцию команды на инциденты.

Инвестиции в инструменты интерпретации окупаются при первом серьёзном сбое в продакшене. Команда устраняет неполадки функций ИИ самостоятельно, не передавая вопросы внешнему поставщику. Прозрачность работы алгоритмов повышает доверие пользователей и упрощает прохождение регуляторных аудитов.

Инфраструктура под гипотезы

Команды часто разрабатывают хранилища признаков для моделей, которые ещё не обучались. Инженеры строят сервисы обслуживания под нагрузку в сто раз выше текущей. Архитекторы закладывают абстракции под типы алгоритмов, которые могут никогда не понадобиться.

Такие инвестиции оправданы при подтверждённом масштабе использования технологий. На этапе проверки первоначального сценария они создают лишние задержки. Команда тратит время на поддержку сложной инфраструктуры вместо получения обратной связи от пользователей.

Преждевременная оптимизация мешает быстрому тестированию гипотез и принятию обоснованных решений. Начинайте с минимального набора инструментов под пилотный запуск. Масштабируйте компоненты по мере роста нагрузки и подтверждения ценности функции.

Измеряйте реальную потребность в ресурсах на основе метрик продакшена. Расширяйте инфраструктуру после получения данных о поведении аудитории. Такой подход снижает риски и ускоряет итерации разработки.

Стоимость и сроки

Бюджет интеграции напрямую зависит от выбранного архитектурного подхода. Подключение готового API через отечественные платформы обходится в несколько тысяч рублей ежемесячно за базовые квоты. Высокие нагрузки увеличивают расходы до десятков тысяч, но прозрачная тарификация за токены позволяет точно прогнозировать траты на сервисы.

Разработка и обучение собственной модели требует инвестиций от 600.000 рублей за рабочий прототип. Production-решение с поддержкой, мониторингом и регулярным дообучением обходится в несколько миллионов рублей. Команда учитывает не только написание кода, но и инфраструктурные расходы: вычислительные ресурсы для обучения, хранилища для данных, системы логирования и алертинга.

Сроки внедрения варьируются от одной недели до нескольких месяцев работы. Готовое решение интегрируется за короткий период при наличии у команды опыта работы с внешними API. Кастомная модель требует два четыре месяца на сбор данных, обучение, тестирование и оптимизацию под целевые устройства.

Проектам с ограниченным бюджетом рекомендуем начинать с пилота на одном сценарии использования. Такой подход позволяет получить первые метрики эффективности до масштабных инвестиций. Команда избегает риска потратить ресурсы на функцию, которая не принесёт ожидаемой отдачи для бизнеса.

Финансовое планирование должно включать резерв на непредвиденные технические сложности. Обучение сотрудников работе с новыми инструментами также требует времени и бюджета. Учитывайте стоимость поддержки и дообучения модели после запуска в продакшен.

Поэтапный запуск функций

Старая логика продолжает работать параллельно с новой функцией для пользователей. Запуск для небольшой группы позволяет собрать метрики эффективности перед масштабированием. Сравнение с контрольной группой показывает реальное влияние функции на ключевые показатели продукта.

Эффективность интеллектуальной функции измеряется через A/B-тесты и анализ воронок конверсии. Опросы пользователей собирают качественную обратную связь о работе новых возможностей. Модели постепенно деградируют со временем без регулярного обновления данных для обучения.

Технические метрики отслеживаются для постоянного понимания производительности системы искусственного интеллекта. Задержки и потребление ресурсов анализируются для дальнейшей оптимизации работы функций. Частота ошибок помогает своевременно выявлять проблемы в работе моделей на ранних этапах.

Система feature flags включает и отключает возможности без развёртывания новой версии приложения. Аварийный выключатель надёжно защищает пользовательский опыт при возникновении проблем с алгоритмами. Контролируемое развёртывание для отдельных групп пользователей значительно снижает риски негативного влияния на бизнес-метрики.

Откат изменений возможен при полном отсутствии ожидаемого результата от новой функции. Гибкость в принятии решений важнее стремления запустить интеллектуальную фичу любой ценой. Временное отключение позволяет доработать функцию перед повторным запуском для широкой аудитории.

Документирование каждого этапа выпуска помогает анализировать долгосрочные тенденции развития продукта. Команда сохраняет конфигурации и версии моделей для воспроизводимости результатов тестирования. Автоматизация сбора метрик обеспечивает оперативное принятие решений на основе актуальных данных.

Юридические требования

С сентября 2024 года в России действуют правила маркировки контента, созданного с помощью искусственного интеллекта. Приложение, которое генерирует текст, изображения или аудио для неопределённого круга лиц, обязано наносить соответствующее обозначение на результаты работы алгоритмов.

Внутренняя аналитика и персонализация интерфейса не подпадают под требования маркировки. Модерация контента без публикации результатов также исключается из регулирования. Консультация с юристом помогает точно определить необходимость маркировки для конкретного сценария использования.

Работа с персональными данными граждан РФ требует соблюдения положений Федерального закона 152-ФЗ. Компания получает явное согласие пользователя на обработку информации в приложении. Хранение и обработка данных обеспечивается на территории Российской Федерации для соответствия регуляторным нормам.

Технические меры защиты предотвращают несанкционированный доступ к конфиденциальным массивам информации. Журналы обработки персональных данных ведутся для отчётности перед контролирующими органами. Шифрование каналов связи защищает трафик от перехвата при передаче между компонентами системы.

Отечественные облачные платформы упрощают соблюдение требований через готовую инфраструктуру. Провайдеры вроде Yandex Cloud и SberCloud обеспечивают локализацию данных в российских дата-центрах. Документация и сертификаты платформ помогают проходить проверки регуляторов без дополнительных затрат.

Анонимизация записей позволяет использовать данные для обучения моделей без раскрытия личностей пользователей. Регулярные проверки безопасности выявляют уязвимости в архитектуре до возникновения инцидентов. Обучение сотрудников правилам работы с персональной информацией снижает риски нарушений и штрафов.

Итоги внедрения ИИ

Внедрение искусственного интеллекта в готовое мобильное приложение не требует полной перестройки архитектуры. Команда добавляет интеллектуальные функции поэтапно, проверяя технические гипотезы на реальных пользователях. Выбор между облачными сервисами и локальными моделями зависит от конкретных задач бизнеса и требований к защите информации.

Успешные проекты начинаются с измеримой бизнес-метрики и ограниченного пилотного запуска. Изолированные модули, кэширование частых запросов и система флагов функций сохраняют стабильность основного продукта. Регулярный мониторинг качества прогнозов и обновление обучающих выборок поддерживают эффективность алгоритмов в долгосрочной перспективе.

Гибкая стратегия интеграции снижает технические риски и ускоряет возврат инвестиций. Цифровой продукт развивается вместе с реальными потребностями аудитории без накопления лишнего технического долга. Эксперты Coding Team проектируют архитектуру под ваши задачи и сопровождают внедрение от пилота до масштабирования.